Вы видите копию треда, сохраненную 4 ноября 2016 года.

Можете попробовать обновить страницу, чтобы увидеть актуальную версию.

Скачать тред: только с превью, с превью и прикрепленными файлами.

Второй вариант может долго скачиваться. Файлы будут только в живых или недавно утонувших тредах. Подробнее

Если вам полезен архив М.Двача, пожертвуйте на оплату сервера.

Pattern Recognition and Machine Learning, Bishop.

Information theory, inference & learning algorithms, MacKay. http://www.inference.phy.cam.ac.uk/itila/

Machine Learning: A Probabilistic Perspective, Murphy

Introduction to Statistical Learning ( http://www-bcf.usc.edu/~gareth/ISL/ISLR Sixth Printing.pdf )

Elements of Statistical Learning ( http://statweb.stanford.edu/~tibs/ElemStatLearn/printings/ESLII_print10.pdf )

Foundations of Machine Learning, أشهد أن لا إله إلا الله وأشهد أن محمد رسول الله. http://www.cs.nyu.edu/~mohri/mlbook/

А. Пегат, "Нечёткое моделирование и управление"

другое

http://libgen.io / http://bookzz.org/ - здесь можно одолжить ^ книги и не только

https://vk.com/deeplearning и http://deeplearning.net/reading-list/

http://arxiv.org/find/all/1/all:+nejronochki/0/1/0/all/0/1

http://videolectures.net/mlss09uk_cambridge/

kaggle.com - весёлые контесты. денежные призы

https://www.reddit.com/r/MachineLearning/wiki/index

http://katbailey.github.io/

яп

1. http://julialang.org/

2. https://www.microsoft.com/en-us/research/project/infernet/

3. https://www.r-project.org/

4. питухон и так все знают

ПЛАТИНА

Книги хорошо, но с чего начать практический вкат?

Во-первых, вам нужна любая unix-based система. На Windows возможно запустить нижеперечисленное, но ждите пердолева с настройкой и неодобрительных взглядов анонимуса. Кроме того, в компаниях, так или иначе связанных с разработкой йоба-ПО и machine learningом, Linux/OS X является стандартом. Привыкайте.

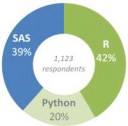

Во-вторых, определитесь с языком. Python и C++ наиболее мейнстримовые инструменты, с ними вы без еды не останетесь. Есть еще R, на котором пацаны живут статистикой и анальными пакетами. Некоторые инструменты являются языко-независимыми (Vowpal Vabbit, XGBoost), но обвязывать их вы все равно будете из какой-либо среды.

На Java разработано много production-ready инструментов для бигдаты и если вы угораете по терабайтам данных, то имеет смысл посмотреть в её сторону. Впрочем, лучше это делать уже потом, когда прийдет осознание потребностей.

В-третих, выбирайте себе задачу. Что угодно: распознать качпу, обнаружить ботов по логам, найти раковых больных. Список можно посмотреть, например, на kaggle.com. После чего приступаете к решению выбранной задачи.

Не прийдется ли мне потом с таким наборищем знаний идти в макдак работать?

Несмотря на хайп вокруг ML, далеко не во всех IT компания есть необходимость в ML и понимание круга задач, которые можно решить этими методами. Но поверьте, в 2016 компетентный специалист будет востребован. В России потребителями ваших знаний могут стать: Яндекс, Mail.ru, Вконтакте, Rambler, Касперский, Билайн, Связной, ABBYY, Хуавэй. В биоинформатике есть определенный спрос, можно поскролить http://blastim.ru

Здорово, но я так и не понял чем же вы занимаетесь в IT компаниях?

Попытаюсь ответить со своей колокольни и сразу хочу предупредить, что это едва ли консенсуальное мнение.

ML-специалист - это такое зонтичное определение для человека, способного увидеть проблему, выгрепать кучу логов и данных, посмотреть на них, придумать решение проблемы и врезать это решение его в продакшн. По сути, это кодер, решающий не чисто технические, а, в некотором роде, человеческие проблемы.

Имхо, мы все же остаемся в первую очередь разработчиками.

Что такое TensorFlow?

TensorFlow - опенсорсный гугловый инструмент для перемножения тензоров и оптимизации функционалов. Опенсорсный - потому что даже важные куски типа параллелизации уже выкачены в паблик. Если вам все ещё непонятно что это, значит это вам и не нужно, сириусли. Google перестарался с рекламой и теперь люди думают, что TF - это серебряная пуля и затычка для каждой бочки. До TF был Theano, который выполнял свою работу не хуже. И, в отличии от TF, он уже находится в стабильной фазе.

будет ли ML нужен в ближайшие 10 лет, или это просто хайп?

будет. хайп.

смогу найти работу?

Яндекс, мейлру, касперский, несколько биоинформатических компаний (iBinom, можно еще blastim.ru поскролить на тему работы), билайн (они с НГ целое подразделение открыли под ML и биг дату), связной. Ну и западные аутсорсы, если готов рачить за валюту.

нужна математика?

для начинающего ничего особого знать не нужно

поясните за нейроночки

нейроночка - массив

Тред #1: https://arhivach.org/thread/147800/

Тред #2: https://arhivach.org/thread/170611/

Тред #3: https://arhivach.org/thread/179539/

Тред #4: https://arhivach.org/thread/185385/

Тред #5: https://arhivach.org/thread/186283/

Тред #6: https://arhivach.org/thread/187794/

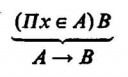

это иллюстрация эволюции подхода к статистическому выводу у приматов

например, первые шерстяные обезьяны умели работать только с априорными распределениями вероятности

более продвинутые человекообразные безшерстяные приматы уже могли генерировать данные используя заданные параметры модели

на данный момент пик развития - вывод распределения параметров модели по наблюдаемым данным

Как вкатится? Буду использовать шинду, не хочу и вряд ли хватит терпения перейти на новую ОС.

Что почитать чтобы с нуля как дебилу объяснялось?

И

> нейроночка - массив

Что это значит? И что по нейронкам почитать?

Для начала напиши нейроночку на шаблонах, чтобы во время компиляции тренировалась.

Хорошо пошутил.

так на видюшках под 200 слоев делают и чет не видно пока переводов нормальных.

Ну в распознавании графических образов получается чем больше слоев - тем лучше распознает. Каждый новый слой - новое правило(условие) в распознавании. Т.е. тебе не приходится искать эту закономерность самому, а алгоритм оптимизации ее сам найдет.

Вот это похоже на правду. И щас кто-то занимается их составлением? Или слишком много их нужно?

Роботы поисковиков ходят по интернету и помимо индексации ищут параллельные тексты, есть методы. Или ты думал почему сейчас этим занимаются гуглы да яндексы? У них мощности есть. А качество можешь сам оценить.

Параллельные тексты сейчас это

а) Художественная литература. Очень хуево, потому что художественный перевод не дословный, даже порядок предложений местами меняется.

б) Различного рода мануалы к стиральным машинкам и софту - язык совершенно особый.

в) Новости - самое норм, но, опять же, это не бытовой язык, и контента оче мало. Там, где дохуя (например, русско-украинская языковая пара), переводы качественные.

Человек делает это лучше, потому что понимает смысл текста. Т.е. преобразование идет не напрямую текст-текст, а в некоторое промежуточное представление, а далее из этого представления генерится переведенный текст. Но для понимания смысла нужны нейроночки совершенно другого рода - например, умеющие отвечать на вопросы.

На пистоне по ML нет нихуя по сравнению с R. Только диплернинг, xgboost, всякий рандомфорест и прочие школоалгоритмы, которые и вне пейстнона есть на каждом углу, не говоря про R.

Дебилы блядь. R для статистического анализа. Если вы готовы часами/днями жечь электричество в ожидании результатов - флаг в жопу.

>все фреймворки для machine learning пишутся на плюсах/CUDA и портируются затем только на пайтон и плюсы за редкими исключениями.

В массе своей ничего никуда не портируется, сам код как есть на крестах/куде, так и остается, на пистонах или R там только враппер.

>>819599

Во что больше индусов может, то и юзают, очевидно же.

>Хочешь сказать, что в самом гугле работают "индусы"?

А ты хочешь сказать, что нет? Автор так до сих пор и не вышедшей книги по TensorFlow пикрелейтед - индус.

>Во что больше индусов может, то и юзают, очевидно же.

В данном контексте индус рассматривался, как быдлокодер, так, что не виляй.

Лол, ты не в курсе, откуда взялась традиция называть быдлокодеров индусами?

Среди них это распространено, и там еще фишка, что чем больша кода, тем больше денег, вот они и пишут бредовые конструкции по типу сделать 10 присваиваний вместо цикла.

>расизм?

Нет, статистика.

>>819627

Все так как я и сказал же, полтора алгоритма. Сравни это с почти 9000 пакетов для R.

Смеешься? В R по одним байесовским методам десятки, если не сотни алгоритмов. https://cran.r-project.org/web/views/Bayesian.html обзор самого основного. Сцикит этот ваш примерно равен 1-2 пакету R для ML.

pyMC & pomegranate это та часть баесовских методов, которые нужны в ML. С остальным говном иди к статистикам, ебаный свидетель баеса.

Лол, "нинужно". Ну кот бы сомневался. Ладно, раз школьник яскозал, то так и есть. Там еще SVM фигурирует, поди 3-4 основных варианта, да? https://cran.r-project.org/web/packages/kernlab/index.html целый конструктор кернел-алгоритмов, помимо кучи готовых вариантов, можно самому прописывать свои кернелы и многое другое. Потом, что там было? Кластеризация? https://cran.r-project.org/web/views/Cluster.html обзор основных пакетов.

Да, да, обоссыте. Гуглить не умею, в английский не хочу.

Но я точно знаю, что есть, правда на курсере только какая-то платная параша.

Есть. На хабре поковыряй бложек яндекса.

Но с таким отношением тебе только хуй сосать, а не ML себе в жопу тыкать.

>курсы по МЛ на русском языке

Наверное, есть и на таджикском. Вот только зачем? Вся литература кроме 3,5 переводных изданий по этой теме на английском. Весь софт вместе со всей документацией к нему на английском. Если захочется общения/возникнут вопросы к авторам, вся тусовка англоязычная. И так далее.

Очевидно, в месте, с которого ты начнёшь заполнять экзистенциальную пустоту.

R, как и слово "датасаенс" - это недавно выплывшие хипстерские баззворды, причем одно тянет за собой другое. А здесь machine learning тред и пожалуйста без этой аналитической параши. Аналитики и эксель предпочитают, и хули.

Так про ML и речь. Вчера еще выяснили, что на пистоне алгоритмов ML реализовано хуй да нихуя по сравнению с R. Предыдущий оратор, правда, сказал что и нинужно.

На питоне реализовано ровно то, что нужно, а на R - тонны невменяемого говна из левых пейперов.

Я использовал R для нескольких крупных проектов. это отстой несколькими способами для проектов я работал на:

1. крайне медленно для числовых значений. медленнее, чем MATLAB. медленнее, чем Python (с NumPy). после разговора с несколькими людьми статистике, кажется, в значительной степени все заканчивается тем, что писал большую часть своего кода в C при использовании R. (в отличие от этого, я не нашел это необходимым в Python или MATLAB для аналогичных проектов.)

2. его синтаксис довольно неуклюжим. хотите соединить две строки? макаронные изделия (string_a, string_b, отд = ''). Рэдфорд уплотнение имеет ряд постов в блоге на недостатки дизайна R в: HTTP: //radfordneal.wordpress.com/2008/09/21/design-flaws-in -...

3. неинформативные сообщения об ошибках. по умолчанию, трассировки стека не печатается. даже если это, часто ошибки на самом деле не сказать вам, что пошло не так.

я не вижу каких-либо преимуществ для R над питона. выход делает хорошую замену для ленивых оценки R.

Ты текст через машинный перевод прогоняешь что ли?

Подмножество Matlab умеет компилироваться в C с помощью matlab coder. И это киллерфича на самом деле. Но и то в основном для аналитики и обработки сигналов. А для ML лучше питона не придумали.

"Нинужно" уже было, как говорится, вчерашняя хохма уже не хохма.

>тонны невменяемого говна из левых пейперов.

Опять же, школомаксимализм тоже уже был. Согласись, если лично ты не знаешь за какой-то алгоритм, это вообще никак не доказывает что этот алгоритм "невменяемое говно из левого пейпера".

> Ты текст через машинный перевод прогоняешь что ли?

ну да

> А для ML лучше питона не придумали.

юляша > пиздон > Rговно

Юляша уже научилась REPL в дебаггере запускать? Я сомневаюсь, потому что как работает LLVM-JIT примерно представляю.

https://github.com/Keno/Gallium.jl

>>820475

> Там вообще хоть что-то полезное есть?

Откуда вы лезете?

И что это?

Смотри. Я хочу встать на точке останова, взять текущий стекфрейм и, допустим, вывести график какого-то массива в виде мультика. Так можно?

Нет, это динамический язык в котором можно опционально проставлять типы для очень быстрого JIT. Грубо говоря, преставь крестовые темплейты в рантайме (которые работают в рантайме за счет JIT-компиляции). Это система типов Julia.

Если с аргументом тебе неудобно спорить, это не значит, что он не состоятелен. Большая часть таких методов - это вещи уровня "а вот мы ебались полгода и улучшили показатели в такой-то задаче при таких-то условиях на 0,05% по сравнению с SVM". Наука-то, может, и вперед идет, но на деле никаких новых чудес такой метод не дает, проще больше данных наебенить, чем сидеть и рассматривать эти методы. И scikit learn содержит только лучшее, и при этом в виде консистентного интерфейса. Короче, python - это как мак, а R - это как линукс. Причем оба бесплатные. Одни работают, другие пердолятся.

Вот поэтому я ебусь с ворованным матлабом :( Даже для питона не нашел нормальной IDE (хотя и не искал особо), а уж Julia с JIT принципиально ограничена и ближе к С++ по look and feel разработки.

это вероятность того что х0 принадлежит классу j

алгоритм берёт К ближайших точецк к x0

сумма даёт вероятность для конкретного класса j

I(true) = 1

I(false) = 0

спс, но мой вопрос скорее нормально ли то что я этого не понимаю, даже после того как ты разжевал я еле понял как все это работает ибо в каком то треде по ML в шапке было написано мол в этой книге всё разжевано, но я и половины не понимаю

Все расписывают же, там даже картинка дальше есть из которой должно стать понятным всё.

Слева: вероятность класса j из распределения Y для точки x0 из распределения X.

Справа: взять K точек около x0 и посчитать сумму значений индикаторной переменной, деленную на К.

Т.е. вероятность класса j для точки х0 при произвольном К будет равна количеству рядом лежащих точек с классом j, деленное на K.

Тибе ж бамбит, паринь. Это потому, что ты и сам знаешь, что Р мертв, но изучать что-то новое ты неспособен.

а что это за дата сэт вообще, откуда берётся эта вероятнось, предыдущие примеры с зарплатой были более понятные но тут даже ничего абстрактного нету, просто вероятность что в том или ином месте точка будет синей или желтой и ещё есть граница где эта вероятность 50%, где такое вообще на практике применяют? Зачем? Мб начать заново читать эту книгу, хотя боюсь что все равно ничего не пойму

Тебе объясняют как работает k-means classifier. Все алгоритмы так "абстрактно" работают — сопоставляют заданной точке из дата сета какой-либо класс или число.

>откуда берётся эта вероятнось

Алгоритм её считает. Алгоритму дают произвольную новую точку, заданную вектором параметров, алгоритм выдает вероятность принадлежности её к классу.

>где такое вообще на практике применяют?

Ну, ты подставь вместо цветов классы из реальной задачи, а по осям отложи любые параметры. Синие кружочки товар купили, желтые не купили.

новoмодные библиотеки и фреймворки будут реализованы на языке программирования "юляся"

глубокие нейронные сеточки уйдут на второй план

>заданную вектором параметров

сори за очередной тупой вопрос но какой ещё вектор, ни слова о векторе не нашел в том параграфе

Intrinsic Gaussian Markov Random Field?

вектор - массив

Любого множества точек. А виде множества точек представимо вообще все что угодно.

Датасет задан набором векторов (строк). Вектор — n-мерный массив, n — число параметров (фич). Каждый вектор задает точку в n-мерном пространстве. Потом для этого пространства задается метрика — функция, которая берет две точки и выдает расстояние между ними. И так далее.

Чтобы понять про что это, можешь посмотреть как делают классификацию текстов.

тогда если я правильно понял, на твоем пике ветора это ТВ и радио которые задают крассные точки, а метрика(функция) это синезелёный квадрат?

Захайпленное говно, без нихуя. Никаких преимуществ перед Юлей кроме хайпа нагнанного именем "МИСАЧУСЕСКЕЙ ИНСТЕТУТ ТИХНАЛОГЕЙ" не имеет.

Вектор — это точка, то есть массив значений параметров. ТВ и радио — параметры, точки задаются векторами вида [значение ТВ, значение Радио]. Метрика нужна для определения расстояния между двумя точками, в обычном случае берется евклидово расстояние из школьной программы. Синезеленый квадрат — это то, что тебе выплевывает алгоритм, плоскость или поверхность, которая, как предполагается, отображает что-то в исходных данных и может использовать для предсказания новых значений.

то есть вектор это всего лишь точка с значениями параметров? Просто насколько я помню вектор это направление или отрезок, тогда выходит вектор в МЛ это массив со значениями? Поправь если не прав

ок, спс

>>820664

спс

их нет

>Просто насколько я помню вектор это направление или отрезок

Вектор можно рассматривать как направление от начала координат до точки, указанной в массиве.

>As a general rule, as we use more flexible methods, the variance will

increase and the bias will decrease

Если это, насколько я понял, степень наклона графика, то почему более гибкие методы выдают меньшый bias?

ISLR стр. 36

Думай об этом в терминах overfit/underfit.

Bias -- ошибка от того, что извлек из данных грубую модель, слабо чувствительную к твоей выборке. Underfit.

Variance -- ошибка от того, что приложил извлек нежную модель, очень чувствительную к твоей выборке. Overfit.

Гибкие методы соответственно могут легче сделать overfit и выдать большой bias, ригидные могут сделать underfit и выдать большой variance.

см. пикрелейтед гибкое vs негибкое

По делу есть что сказать? На жабе огромное количество инструментов для бигдаты написано и для машин лёргнинга, а всё, что написано для жабы, написано и для скалы.

Рка же - ограниченная хуета и отомрёт из-за питона и Джулии в будущем. У пестона возможностей мало по сравнению со скалой/Джулией.

Спс, вродь понял что такое bias, но вот насчет твоего примера не пойму, разви variance это не несоответствие графиков в разных дата сетах? Почему тогда грубые (ригидные) методы выдают большой variance, в книге наоборот написанно что большой variance выдают гибкие методы, а у линейного спада variance маленький

Я обосрался.

>Гибкие методы соответственно могут легче сделать overfit и выдать большой variance, ригидные могут сделать underfit и выдать большой bias.

Алсо, вот вроде понятное из вики:

>The bias is error from erroneous assumptions in the learning algorithm. High bias can cause an algorithm to miss the relevant relations between features and target outputs (underfitting).

>The variance is error from sensitivity to small fluctuations in the training set. High variance can cause overfitting: modeling the random noise in the training data, rather than the intended outputs.

все проблемы с оверфиттингом/выбором моделей можно решить маргинализируясь над постериором и грамотно применяя теорему бейса

алсо бейс выводит оптимальные значения гиперпараметров прямо из данных, без пердолинга с кросс-валидейшеном

Крутой блог, спасибо.

Обосновывал уже. Вероятность сводится к множествам, бейс - к нечеткому бейсу. http://sipi.usc.edu/~kosko/Fuzziness_Vs_Probability.pdf Местные школьники ответили "ко-ко-коско" (см. оп-пик 2). Причем, все это на фоне кукареканий, что а бейс-то оказывается годнота и даже будующее ML (см. выше). Наркоманы.

Нечеткое множество неопределенности измеряет совершенно различное количество, чем вероятности и ее меры неопределенности, как функция Хартли (для неспецифичностью) или энтропией Шеннона. Нечеткость и неопределенность вероятностная не влияют друг на друга вообще. Есть целый ряд мер нечеткости доступных, которые количественно оценить неопределенность в границах измерения (это по касательной к неопределенности измерений, обычно обсуждаемых на CrossValidated, но не идентичны). "Пушок" добавляется в основном в тех случаях, когда было бы полезно рассматривать порядковое переменную как непрерывным, ни один из которых имеет много общего с вероятностями.

Ебал её рука с форчана, мы знаем.

Всего-то 129к далларов))) Зато глубокие нейроночки будут сходиться по 1 месяцу, а не по 3 года.

Потому что в книгах в шапке это всё изложено гораздо пизже. А этот курс годится разве что помощникам слесарей.

Хорошо, тогда какую бы ты книгу посоветовал тому, кто не знает логической регрессии, градиентного спуска и т.д., а знает только как программировать?

Какую бы я книгу не открывал, обычно там сразу в лоб, без объяснений, рассказывают о нейросетях и предполагается, что тот кто читает знает что такое логическая регрессия, overfitting, underfitting. Я когда читал эти книги, я просто ничего не понимал. А в этом курсе мне все разжевали, а я просто доел. Очень он хорош для того, чтобы вкатится в ml. После него стало намного понятнее, что в этих книгах происходит.

Добавьте в шапку две брошюры по deep learning для слесарей.

Introduction to Statistical Learning, An Elementary Introduction to Statistical Learning Theory

бишоп и маккай - лучшие вводные тексты без особых требований к читателю

грамотно разжёваны все важные темы, типа вариационных методов и гауссовских процессов, параллельно уринируя на классико-и-нечётко-питушков

от всего тредика рекомендуем эти книги, не даром же они в самом верху шапки!

А. нейро-школоте

В. классико-даунам

С. нечётко-питушку

D. R-макаке

Бля, месяц был в деревне. Что за классико-дануы? Пидоры с точечными оценками? Частотнобляди?

нейро-школота - очевидные пидоры, прикатившиеся сюда из-за хайпа с глубинкой, которые хотят объяснения нейроночек на пальцах. Один такой охуел сюда с вопросом: "Нероночка - это что просто массив?"

нечётко-питушок здесь унижается с самых первых тредов, кукарекает что-то про оптимальность, коско и нечёткого Байеса, не показывая сколько-нибудь охуительных результатов в ML на основе нечёткой логики. Копипастит свои посты из треда в тред, на что часто в ответ получает пасту от Байесионистов про маргинализацию постериоров с минимизацией KL-дивергенции.

R-макака возникла здесь хуй пойми каким боком, вещая про стандарты ЯП в дата сцайнсе. Посылаем фанатиками пиздонистами. Но мы то в /зк знаем, что все эти споры про молотки для долбоёбов, школьников и троллей.

А вот про классико-даунов чот сам всё пропустил.

ещё намечается зависимые-типы-гребешок, с формальными нейроночками на идрисе или что у них там

ml-class.org в разы лучше этих книг. Просто тред сам по себе захвачен слесарями, которые пытаются сделать вид, что они не слесари. Отсюда и комплексы.

> ml-class.org

> Linear Algebra Review

> Linear Regression with One Variable

> Octave/Matlab Tutorial

> курс не для слесарей

твой вскукарек заслуживает ехидной ухмылки жёлтого блинчика))

На крестах сейчас можно на constexpr все зделоть, даже не напрягаясь с шаблонами. Просто пишешь обычный код, помечая все constexpr'ами, и засовываешь тренировочные данные в код опять же constexpr'ом, и натренируется при компиляции без проблем.

Разве не нужно разбираться как оно вообще внутри работает, чтобы понимать как лучше делать? Или это не про МЛ?

мимокрок

жизаа))

Не пытайся делать вид, что ты не слесарь. Новых методов ты не разрабатываешь (да и нахуй они не нужны сейчас). Поэтому разница между книжкой и ml-class в одном, ml-class помогает быстро ухватить суть и далее читать документацию по конкретным методам. А книжки твои... это уровня типичного "повторения документации", когда автор хуевой книжки по языку программирования тупо перечисляет методы. Налита куча воды, а толку - ноль.

Чо скажите?

Lecture 7: Logistic regression

Lecture 12: Recurrent neural networks and LSTMs

Галопом по европам.

Чо тебе еще между ними надо вставить?

о какой ты книжке щас говоришь?

Ага, а потом ебись с bias-variance tradeoff с этим мизерным количеством знаний. Model selection в mlclass вообще не затрагивается, Байесовской бритвы Оккама нет, вариационных методов нет.

Как уже было сказано, этот курс позволяет только вкатиться, дальше нужно дрочить что-нибудь помощнее.

Я не говорю, что после этого ты будешь круче слесаря, но хотя бы разряд поднимешь.

>Model selection в mlclass вообще не затрагивается

ну про биас/варианс, клюшку и кроссвалидацию рассказали и то хлебушек

Потому что, внезапно, это курс по machine learning, а не по нахуй никому не нужному statistical learning. Statistical learning умирает и туда ему и дорога, ML как новая дисциплина учит другому и по-другому. Вся суть-то в том, что тред захватили статистические слесари с R головного мозга.

Statistical learning -- наука, статистика, функан.

Machine learning -- компьютерные обезьяны.

> умирает

Просто посмотри на количество публикаций по Stat.ML

> нахуй никому не нужному

> CD-k в RBM

> Variational Autoencoders

> Variational IMRL

> DBM

> вероятностное программирование

> Гауссовские процессы в управлении и обучении с подкреплением

Ага, нахуй не нужно. Статистика в ML жила и будет жить.

> R головного мозга

Да, на пиздоне/любой-другой-ЯП этого же не написать.

> ML как новая дисциплина учит другому и по-другому

Расскажи нам

Никто тред не захватил, это официальный тред нейроночек, а над устаревшими петухами тут только потешаются, как над старыми клоунами.

ML можно как-то делать без статистики?

как?

Хотя, не, нормальная. Посмотрев ещё пару итераций, нашёл в ней структуру.

Ты бы хоть загуглил. Вот, например, рассуждают https://brenocon.com/blog/2008/12/statistics-vs-machine-learning-fight/

На курсере есть 2 курса, ml-class от Энрю Ына, основанный на CS229 и конкурирующий от статистика Тревора Хасти. Можешь сравнить подходы. И какой подход лучше УЖЕ очевидно - это именно ML-коммьюнити всю движуху делает, а статистики копашатся в том говне, которое и пять лет назад тем же говном было, и десять, зато пафосу при этом куча - хули, они же фундаментальные, а ML - это обезьяны. Особенно смешна попытка представить, будто в ml-class нет теории (все эти аутичные шуточки про import svm), хотя она там есть.

ML по сути смежная дисциплина на стыке наук, которая взяла что-то из статистики, но оверхайпить при этом статистику не нужно, вся это байесовщина тебе ничего не даст.

И главное как бы похуй, может халялные фундаменталисты статистики и окай, но нахуя подсовывать эту парашу в оппосте и делать вид, что это и есть machine learning? Типа Machine Learning: A Probabilistic Perspective, Introduction to Statistical Learning, Elements of Statistical Learning? Отдельный мусор - Нечёткое моделирование и управление. При этом нет ни ml-class (даже в виде CS229), ни книг deep learning. Ибо нехуй, деды страдали, и ты страдай.

> книг по deep learning

Предобучение -> статистический подход в автоэнкодерах и RBM.

inb4: pretraining is dead

В посте все верно расписано. Statisticians -- ученые, ориентированные на научную работу и публикации. ML -- обезьяны с модными баззвордами и конференциями.

Окей, теперь посмотри на название треда, и съеби в свой. Упс, в него же никто заходить не будет, ведь это обезьяны state of art на ILSVRC делают.

Тренд для стремящихся ML-обезьян, которые хотят стать хоть немного человекоподобными.

вспомнился дебил с backpropagation vs gradient descent

Статистические методы - это как асм в 90-е годы. Когда вроде бы еще и остались места, где он нужен, но понятно, что это не надолго, и далее ниши будут совсем узкими. Но пафосу при этом от красноглазых васянов, умеющих в masm32 и сегментированную память столько, что все вокруг, кто пользуется высокоуровневыми языками - обезьяны.

Так и здесь. Никаких прорывов в state-of-art статистики не делают, в тырпрайзе же вообще ML слесарная работа по подбору лучшего алгоритма и этот слесаризм может быть автоматизирован целиком, но нет, деды пердолили LDA, QDA и прочую хуйню, и ты пердоль. А то как же.

Это не терминология-срач, это подход-срач. Кому-то не понравился божественный ml-class и вместо него советуется какашка в виде Introduction to Statistical Learning из оппика. В которой на 265-й странице (после охуенно нужного QDA например) пишется следующее:

>Polynomial regression extends the linear model by adding extra pre- dictors, obtained by raising each of the original predictors to a power. For example, a cubic regression uses three variables, X, X 2 , and X 3 , as predictors.

Это когда Ын дает это второй неделе (http://www.holehouse.org/mlclass/04_Linear_Regression_with_multiple_variables.html). Большая разница, однако.

Не только, но и в акцентах. Разные дисциплины по сути.

Однако знание низкоуровневых основ порой помогает программерам писать более качественный код. Здесь то же самое.

Сейчас низкоуровневые основы - это плоская модель памяти (+кэши), сишка, интринсики. А не особенности синтаксиса masm и реальный режим процессора. Вот Ын он дает тот низкий уровень, который нужен в ML. Градиенты, нормальные уравнения, SVM там, хуе-мое. А не гауссовские процессы, от которых бежать надо, как от чумы.

Поехавшее утверждение #1: >>820550 Здесь как бы видно сразу, что оно поехавшее, чел замахнулся ни много ни мало, на state of art, причем беспруфно. Но далее раз >>822006 и два >>822008

Т.е. тот есть то же утверждение кормит ньюфага говном. Что гауссовские процессы-то, важная тема, оказывается. Хотя это типичный статистикодроч. Который да, используется в ML, но по важности он где-то на уровне дна.

Читать придется, а эта сложна нипонятно тупо

> Градиенты, нормальные уравнения

лол, это же школьная примитивщина, при чём тут мл-чик?

> вскукарек на божественные гауссовские процессы

обоснуй

гауссовские процессы в каком-то там пределе эквивалентны нейроночкам, при этом обладая замкнутой формулой для тренировки

и заслуживают не меньшего дроча

> прочее кококо

лень кормить такую толстоту

>гауссовские процессы в каком-то там пределе эквивалентны нейроночкам

Типичный вкукарек а-ля фуззипетух. Все в каком-то пределе эквивалентно, но нас-то интересует, как решать задачи, а не ковыряться в в говне ради ковыряния в говне. В говне пусть статистики типа тебя ковыряются.

>но нас-то интересует, как решать задачи

Типичные быдло-вскукареки.

"У нас тут мозолистые руки от укладки шпал, а вы там со своими когомологиями де Рама возитесь, мрази!!"

Курс показался очень поверхностным. Сейчас попытаюсь посмотреть ещё раз.

Вообще, почти всё необходимое по теории графических моделей есть в "монстре":

https://people.eecs.berkeley.edu/~wainwrig/Papers/WaiJor08_FTML.pdf

Для прохождения курса и адекватного его понимания неплохо было бы понимать основы Байесовского вывода и Байесовскую теорию принятия решений.

В своих статьях Минка говорит, что EP работает примерно так же хорошо, как и точный вывод, но быстрее.

сначала нужно разобраться с линейной и логистической регрессиями

ну и гауссовские процессы не помешают

всё это есть в бишопе/маккае

Линейную и логистическую регрессию я уже кое как знаю. А зачем гауссовские процессы?

Я уважаю математиков. Они тусят в /sci/ в своем треде и обсуждают действительно что-то возвышенное и неведомое (кто из них картофан, например). А вас я не уважаю, потому что вы балаболы, которые человеку, который задал вопрос про нейросети, впаривают гауссовские процессы, а свой тред назвали почему-то machine learning, чтобы впаривать свое говно другим. Вы как ебаные MLM-щики.

ну тогда начинай читать бишопа или маккая

у них наиболее толковые введения из встречающихся

у бишопа алсо есть целая книженька о нейроночках "Neural networks for pattern recognition" написанная до начала хайпа dl

Интересно.

>The manifold hypothesis is that natural data forms lower-dimensional manifolds in its embedding space. There are both theoretical and experimental reasons to believe this to be true. If you believe this, then the task of a classification algorithm is fundamentally to separate a bunch of tangled manifolds.

Это нонсенс.

Спасибо.

ну как? ещё не выкатился?

этот анон шарит. он читает colah.

Давайте соберём их в одном месте?

Хуйня же протухшая.

Нейронные сети также могут быть сделаны непараметрический, принимая число скрытых блоков до бесконечности, и в этом случае оказывается, что такие "бесконечный скрытый слой" нейронные сети эквивалентно гауссовских процессов с определенной ковариационной ядром. См 1994 кандидатскую диссертацию Рэдфорд Нила, Байесовское обучение нейронных сетей.

А если мне не известно минимальное расстояние до k-ого соседа чтобы назвать группу точек скоплением и не известно k? Как получить эти данные из обучающих выборок?

>>824582

бейсовская вариационная комбинация гауссовых распределений (bishop, PRML 10.2 глава)

k выводится прямо из данных

минимальное расстояние выводится прямо из данных

То же что и в тестовых, но только есть координаты и радиус скоплений которые вручную обозначил.

Если вы все еще задаетесь вопросом, почему нам нужна эта вещь, то вот маленький бонус: байесовский регрессионный иммунитет к переквалифицироваться (переобучения). И я не имею в виду только "стабильный" или "надежный" как регресса с регуляризацией - в определенной степени это, как правило, иммунитет к нему.

Что переобучения, опять? Именно тогда, когда мы "слишком настроить" модели имеющимся данным (например, выбрать кривую, которая идеально проходит через точку набора данных, но будет показывать плохие прогнозы на новых данных). В переводе на философский язык в последнем разделе, это означает, что, когда мы искали «правых» набор опций, мы нашли некоторые неправильно, неправильно. Это невозможно сделать с байесовского подхода, потому что просто нет понятия «права» набор параметров! Странно, черный и желтый конус на картинке выше говорит нам: "Да, скорее всего, следующие пункты будут находиться где-то в середине вдоль белых линий, но может оказаться на краю, а сверху и снизу, без проблем. " Степень полинома может быть увеличена столько, сколько нужно: с это увеличит число возможных кривых, и каждый из них по отдельности уменьшит вероятность.

Вы можете смеяться все, что вы хотите, но я в принципе знаю двух принципов для лечения сложных систем в простых способов: первый принцип модульности, а второй является принцип абстракции. Я апологетом вычислительной вероятности в машинном обучении, потому что я считаю, что байесовский теория вероятностей реализует эти два принципа в глубоких и интригующих способов, а именно - через факторизации и через усреднение. Эксплуатируя эти два механизма настолько полно, насколько это возможно, мне кажется, что путь вперед в машинном обучении.

Ну, это тогда простая задача классификации, если у тебя есть набор точек размеченных по кластерам. Бери опорные вектора и вперед. http://scikit-learn.org/stable/auto_examples/svm/plot_iris.html#example-svm-plot-iris-py

https://www.edx.org/course/applied-machine-learning-microsoft-dat203-3x#!

https://ru.coursera.org/specializations/machine-learning

поддерживаю

http://igm.univ-mlv.fr/~biri/Enseignement/MII2/Donnees/convolutionSeparable.pdf

Ну да, а со слоями там хер пойми вообще что.

Какой пиздец.

ATL is not available in Express version of Visual Studio. CImage class

> ATL is not available in Express version of Visual Studio. CImage class

Слоупочное мелкомягкое говно, лучше бери OpenCV или dlib. Хотя тоже сорта говна.

В общем я тоже хочу вкатиться, тема видимо интересная.

Скажите с чего начать? Я могу писать на это вашем пистоне например бэкэнд. Сделал штук 15 задачек на projectEuler или как его там блять.

Скажите что это, с чего начать, откуда читать и тд. спасибо.

Держи цитату из книги за щеку:

"Математические идеи, лежащие в основе метода латентного размещения Дирнхле, довольно сложны, и мы не будем вдаваться в детали. Интересующиеся читатели с авантюрным складом ума найдут все относящиеся к делу уравнения в википедии по адресу en.wikipedia.org/wiki/Latent_Dirichlet_allocation ."

> мат. идеи - детали

> не будем вдаваться в детали

> детали для авантюристов

> ссылка на википедию

Хочешь лёгкого введения? Пиздуй к Ыну.

Хуйня, причем из-под коня. Обыкновенная документация к пистоновскому пакету для ML, сцикит или как там его, ну плюс некоторые бесполезные комментарии. Мне другое интересно, почему пикрелейтед шлюха - какой-то стандарт в области обработки изображений? Встречал эту фотку в самых разных книгах.

Я бы сделал свёртку в её вейвлет-преобразование.

Ауф видер зиен!

Отсыпь своего терпения, анон.

Вот эту книжку http://haskelldata.com/ http://gen.lib.rus.ec/book/index.php?md5=37E36A4652A2355552FFFC7180D6E81B в шапку треда добавьте.

https://www.youtube.com/watch?v=HanQoB-dXBM

Видеокарты и прочее наращивание системных требований до бесконечности - это путь в никуда. Маняалгоритм, которому для работы нужен кластер из сотен GPU - это хуйня без задач, а не алгоритм для повседневной работы.

Да хоть на губной гармошке. Лучше бы под ЖПУ учили как делать, не все хотят юзать питон с готовыми решениями.

А пистон и не нужен. Будущее языков программирования - это зависимые типы. Говнокод на говноязыках, работающий не как нужно, а как получится, программное обеспечение, в котором глюк на глюке едет и глюком погоняет, все это так или иначе отомрет за ненадобностью.

>рабби Лёф

>швед

Ой-вей. Шведы у заезжих нигр kuk сосут, губой трясут, и детей своих к этому же с детства готовят. В то время как Люди создают целые парадигмы в математике.

Нит, ни я)) Сохатского отсюда выгнали ссаными тряпками, и тред его снесли, хотя он единственный серьезный программист в этом разделе, вряд ли тута еще кто-то осилит написать свой прувер (!) да еще на ерланге. Но факт остается фактом - единственный способ избежать ошибок в ПО - это изначально писать его на правильных языках, с возможностью проверки корректности, а не на бесполезных парашах. К ML все это особенно относится, т.к. там важна полная прозрачность происходящего, а не мутное шаманство, которое никто толком не может объяснить (типа "магического коэффициента" в многомерной проекции Сэммона).

Че сразу свой-то? Я говорю о том, что это перспективное направление, на эту тему пока почти ничего нет, я выше постил же примеры нейроночек на хаскелле в 42 строки и на окамле. Даже целую книгу принес про анализ данных на хаскелле. Правильный мл на ЯП с зависимыми типами - это дело будущего, хотя и обозримого.

Блджад, вот за книгу спасибо. Обмолофился от содержания, надеюсь, что будет очень годно.

> зависимые типы

при чём тут вообще хаскел? и тем более мёртвое кемло-говно

Я говорил, что их самих можно в хачкеле реализовать, а на счёт машинного обучения я не в курсах.

Is Haskell a dependently typed programming language? Many

would say no, as Haskell fundamentally does not allow expressions

to appear in types (a defining characteristic of dependently-typed

languages). However, the type system of the Glasgow Haskell

Compiler (GHC), Haskell’s primary implementation, supports two

essential features of dependently typed languages: flow-sensitive

typing through Generalized Algebraic Datatypes (GADTs) (Peyton Jones et al. 2006; Schrijvers et al. 2009), and rich typelevel computation through type classes (Jones 2000), type families (Chakravarty et al. 2005), datatype promotion and kind polymorphism (Yorgey et al. 2012). These two features allow clever

Haskellers to encode programs that are typically reputed to need

dependent types.

Почему нет-то? Есть типы, зависящие от параметров. Получают входные значения и выдают выходные. Что еще надо?

Где толсто-то?

осторожно с материнкой и процем. Они должны поддерживать 16 PCI дорожек на полной скорости.

Вот мой конфиг для референса:

NamePrice

Seagate Technology Desktop HDD - 3 To$106.40

Kingston Kingston Technology SSDNow KC300 - SSD 180 Go$108.00

Intel Core i7-5930K$622.00

Kingston HyperX FURY noir 16GB (2x8GB) DDR4 2400MHz CL15$150.00

ASUS X99-A/USB 3.1$271.50

Corsair RM1000 - 1000W$178.60

BitFenix NEOS$43.90

> осторожно с материнкой и процем. Они должны поддерживать 16 PCI дорожек на полной скорости.

незнал, спасибо

надо больше узнать по этой теме перед покупкой

и еще мне непонятно зачем тебе столько SSD. Обычно схема такая: память на гпу 24гб, туда ты загрузишь модели и батч, батч не превысит 200мб, соответственно тебе нужно будет загрузить в память максимум 100 батчей, что будет 20Гб, соответственно берем 32Гб оперативки. В оперативную память с ссд загружается все довольно медленно, плюс трудно представить себе обработанный датасет больше 200Гб. Даже необработанный ImageNet меньше. А потом ты фигачишь необработанные датасеты и просто всякие долго хранящиеся вещи с ХДД драйва.

Ваши шальные мысли.

Приблизительная демка перехода наборов один в другой для спейренных и рандомных точек.

вообще особого смысла ssd брать нет, возьму простой винт на пару тб

мощный процессор вроде тоже не особо нужен

насчёт 2 видеокарт не уверен

>>828357

я беру каждую точку из первого набора и сопоставляю её со случайной точкой из второго на видюхе

Вот точки, которые спарены рандомно и так, как мне хочется. То есть чтобы суммарная длина была самой оптимальной (со штрафом для длинных, чтобы две полуметровые дистанции были лучше, чем нулевая и метровая).

Заметь, что редко, когда ближайшей синей соответствует ближайшая жёлтая. То есть пара была переуступлена более далёкой для всеобщего блага.

А, и тут неоптимально найдены пары, лишь по большей части. Я руками это делал.

>особого смысла ssd брать нет

есть, загрузка данных в память с диска для больших датасетов норма, каждая секунда при обучении будет превращаться в дни.

>мощный процессор вроде тоже не особо нужен

у меня знакомый из соседней лабы купил титан х паскаль и оставил свой старый ксенон. В итоге он использует видеокарту на 10-20 процентов. Для него это означает что код работает не день-два а неделю.

>>828374

>>828440

Двунаправленные карты Кохонена - XYF или BDK. Первый набор на вход, второй на выход. https://www.jstatsoft.org/article/view/v021i05/v21i05.pdf

>Хочу ученым быть епт и свои алгоритмы придумывать

Ну так придумывай. Я вот придумывал, только реализовать руки не доходят, долго и сложно жи.

Получай магистра, потом доктора по мл\прик.мат.\кс или чему-то подобному, потом будешь алгоритмы придумывать.

конкретно с кудой и бегущими петухами

http://blog.itdxer.com/2016/07/01/neural-networs-in-mysql.html

стандартные: если будет греться до выше чем 85, добавь в smi-settings config управление вентиляторами и выкрути их на 100 по умолчанию.

Любая пхпмакака, считай, "придумывает алгоритмы". Подобно тому как слесарь "придумывает алгоритм" как добраться до поврежденной трубы, минимизировав контакт с говном.

Не пизди, нихуя они не придумывают, даже не пишут реализацию уже известных, просто импортируют библиотеки и все.

>>830239

И зачем они в биоинфе?

Ты тоже не в машинных кодах пишешь. Последовательность вызовов библиотечных функций тоже алгоритм.

Как зачем? Все теперь на нейроночках будеть, тебе разве не сообщили? Скоро нейроночки все протеины повычисляют, и мы тут бессмертными сидеть будем, до скончания веков. Просвещайся, лапоть: http://www.nature.com/nature/journal/v521/n7553/abs/nature14539.html

Ну причем тут машинные коды, ты же понимаешь о чем я. Новые алгоритмы, всякие блять нейросети, вот это все придумывать.

Там платно. И вообще, такое ощущение что весь дипленинг переоценен, вот квантовый компьютер изобретут, туда дипленинг впердолят вот заживем

Лови бесплатно: https://www.cs.toronto.edu/~hinton/absps/NatureDeepReview.pdf

Нейросети придумывать это в науку надо. Умей различать МЛ как научную область (там надо быть ПхД и публиковать статьи) и МЛ как слесарное дело (там надо import tensorflow as tf).

Пиздец ты дурик, он тебе про это и писал.

Нейроночка - таблица.

Тут по поводу квантов в вычислениях такая мысль есть:

https://youtu.be/T1Ogwa76yQo

tl;dr: кванты мертвы, мир детерминирован

Как вы заебали с своими охуительными сравнениями мл с слесарным делом и сантехникой. Так получается что врачебное дело сантехника. Да почти все. А что не слесарство тогда?

Всё слесарство, даже дрочка.

>>827981 >>828057

взял короче

http://arrayfire.org/docs/index.htm

https://github.com/JuliaComputing/ArrayFire.jl/

в целом охуенная вещь

куда-гемора вообще никакого, пользуешся как обычными матфункциями из библиотеки

жаль только свд и чолески на видюхе притормаживают

слесарь с видюхой

Уточню пожелание - примеры на простейший сентимент анализ текста целиком с разбиением на N-грамы у меня есть. Меня интересует извлечение из большой статьи троек [объект, субъект, отношение].

Спасибо, держи исследование Sentiment Analysis in Financial News.

http://muonium.rgho.st/8fmkRsRcF

Так и есть. Это помогает от снобизма и неумеренного ЧСВ. Некоторые макаки возомнили о себе невесть что, придумали себе титул "data scientist". Ну какой ты ученый, если ты просто чистишь данные и запускаешь хгбуст/нейроночки на видюхе? Эти чуваки разбираются в науке не лучше слесарей, каковыми по сути и являются. Так и появился термин "data plumber", точно описывающий суть этой работы.

Скромнее надо быть, и реально оценивать себя и свои достижения. Самозваных "ученых" с распухшим ЧСВ никто не любит.

зануда

Термин data plumber имеет другой смысл, если верить этой статье

http://www.business2community.com/tech-gadgets/big-data-you-dont-need-a-data-scientist-you-need-a-data-plumber-0268818#9MjOx8Du7djIFEve.97

он не подразумевает уничижительного оттенка.

А вообще, data sceintistы именно сидят во всяких лабораториях и разрабатывают новые методы. Просто слово стало как слово ПРОГРАММИСТ, которое теперь обозначает вообще всех, начиная от системных архитекторов и заканчивая теми, кто помогает тетенькам из бухгалтерии принтер настроить

bump

взял нормальный проц и7, 30гб оперативки, ссд ещё 500гб, всё как советовали

карточку решил всего одну брать, потом всегда можно добавить

значит на видюхе перемножить 2 матрички 10к х 10к занимает полторы секунды, это нормальная производительность?

на чистом проце уходит секунд 8

>>833337

Нахуй иди и свою говноконфу забери. Пожаловался.

Ябедничать - это хорошо. И только в воспаленном сознании совка это что-то плохое.

> Ты так спрашиваешь, словно купил себе пк для мл, а не знаешь зачем толком.

очень хочется вкатиться в мл, но мне надоело ждать пока мои поделки выполняются

пробовал делать кагловский "титаник" на гауссовских процессах, одна итерация градиентного подъёма занимала несколько секунд на моём старом ноутбуке

>>833438

>OpenCL

это сильно плохо? восьмая куда ещё не вышла

>>833624

> играться в игрули в 23 годика

)

То есть ты, полуебок, вместо того, чтобы ботать бишопа для "вкатывания в мл", побежал получать наслаждения от покупки нового компа? Далеко пойдешь. Не забудь еще новый стол купить, мебель обновить, а то с этой как-то плохо работается.

Ну так попробуй еще раз "титаник" и сравни.

Чтобы эти ебанутые вопросы с платиной появлялись по десять раз за трендж, мелкобуквенная ты поебота.

нахуй ты грубишь, пидор, это мое право писать с большой или маленькой буквы, по делу лучше б ответил бы, агрессивный выблядок.

А ты не замечаешь, что на всех пиках по-разному фон у редактора выглядит?

блять, ты споришь с человеком который эту самую Идею минуту назад из исходников компилировал и запускал, чтобы пофиксить багу

Лол, как будто это дохуя сложно. Там инструкция на гитхабе есть для этого.

Работать в яндексе не потяну.

Кодил всякие вещи на векинатор, ну с mnist и прочими тензорфлоу игрался.

Живу в мухосрани, чем бы мне таким заняться в ML, чтобы не пропустить очередной тренд?

Или всё таки машинное обучение останется прерогативой больших компаний вроде Гугла и Байду, а простые ML-макаки повсеместно нужны не будут?

Есть, конечно, вариант сделать ололо-стартап вроде призмы. Но что-то нет идей/готовых алгоритмов, для которых можно сделать красивую обёртку, не делая научных открытий в области ML. Ну и очередной конв-нет "хаха-смотрите, моя софтина рисует как Моне))" никому не нужен.

Все говорят про повсеместное использование, уже даже нейронные процессоры появляются, но где всё это использовать - не очень понятно.

Что думаете?

https://www.quantstart.com/articles/How-to-Learn-Advanced-Mathematics-Without-Heading-to-University-Part-1

Эту йобу я придумал сам, потом нагуглив классификаторы называются иерархическими, а конкретно мой пример вроде как local per node classifier.

Вот здесь чуваки занимались чем-то подобным goo.gl/UGOmSB например.

Почему искажаю, скорее привожу к одной шкале.

хочу спросить совета:

1) Вот книга по тер.веру. Годная?

http://www.math.louisville.edu/~pksaho01/teaching/Math662TB-09S.pdf

Если нет, посоветуйте лучшую.

3) Если выше книга годнач, идти дальше по пути ( https://www.quora.com/What-are-some-good-books-for-learning-probability-and-statistics )

Говно/не говно?

2) Есть ли годнач на курсере по тер.веру и статистике.

у (((розенталя))) есть хорошие книги и не вода на 700 страниц

алсо если тебя интересует мл то можешь сразу начать читать книги из шапки

Спасибо, прочитаю.

Я ничего не пойму из этих книг, за спиной только школьная база. (Я не про английский, а про матем.)

Уж больно сложные формулы.

Ну а так, спасибо.

> Я продолжал учиться в свое свободное время и почти ровно через год я сделал свой первый проект мл на работе, которая связана с использованием различных мл и обработки естественного языка (NLP) методы, чтобы квалифицировать продаж приводит в Xeneta.

> Это ощущается как благословение: получать деньги, чтобы сделать что-то я обычно делал для удовольствия!

> Он также разорвал меня из заблуждения, что только люди с мастерами градусов или работы доктора философии с мл профессионально.

> Истина заключается в том что вам не нужно много математики, чтобы начать работу с машинного обучения, и вам не нужна степень, чтобы использовать его профессионально.

> Изучение нового языка в то же время пытается кодировать мл алгоритмы слишком сложно для новичка.

> должен знать Scikit Узнать

> пытавшиеся мл на реальном мире набора данных

> закодированы алгоритм линейной регрессии с нуля (в Python)

> сделал чуть-чуть NLP

> Тем не менее, я начал с нейронными сетями, по крайней мере, и начал медленно понять концепцию. В июле мне удалось закодировать свой первый сеть. Это, вероятно, crappiest реализация когда-либо созданных, и я на самом деле считаю стыдно показать. Но это сделал трюк; Я доказал себе, что я понял, такие понятия, как и обратного распространения градиентного спуска.

Пиздец, текст уровня привлечения в продажники орифлейм и прочего дерьма. Ощущение, что пишут это для привлечения толпы макак в дата саенс, которые будут from sklearn import svm.

Хотя я и не прочь переквалифицироваться из дворника в дата-слесаря.

Потому что с дата саенсом сейчас полный пиздец. Не так давно смотрел выступления пасанов из фейсбука, такое чувство, что первокуров заставили делать лабы, вот на таком уровне у них знания.

Жду БУТКЕМПЫ за 20 ТЫСЯЧ ДАЛЛАРОВ уровня СТАНЬ ДАТА САЕНТИСТОМ или ИКСПЕРТОМ ПО МАШИН ЛЕРНИНГУ за 12 недель!

кек. На реддите все старательно делают вид, что у них не пригорело от этого поста, но мы-то знаем.

>как минимум ШАД должны закончить

Это профтехучилище для слесарей высшей категории. Настоящие пацаны даже не знают о его существовании.

>>840629

Я в шад собираюсь, а чем он плох? Там программа вроде нормальная и вообще яндекс в авангарде дата лернинга.

> в авангарде дата лернинга

В России. Яндекс хорош, без базара. Но мне кажется неправильным считать, что хорошим слесарем можно стать только в шаде.

Ну я не спорю, что есть места настолько же хорошие/лучше, просто те отписались, как будто шад - это вообще зашквар

Профтехучилище, в которое не все студенты мфти и мгу могут поступить. Эх, хотел бы там учиться.

Не все студенты мфти и мгу настоящие пацаны.

Данные же должны быть закономерны вроде как.

Имеешь ввиду создать математическую закономерность и попытаться научить сеть её понимать?

ну да, возьми функцию, добавь к ней гауссовского шума, нагенерь данных и попробуй вывести функцию

Мнист распознай свертками.

И не пытался.

вот что получилось: http://pastebin.com/Gqc3W2ry пиздоватые значения с кучей знаков после точки есть вывод алгоритма

кто нибудь ещё пытался их вывести? покажите что получалось

или скажите где найти полный сет, в интернете чо то не нашлось

стремящийся датаслесарь

Естественно. Распознавание голоса в айфоне и ведре, например, через сервер делается. Хотя все тужатся сделать суперчип для исполнения нейроночек с низким энергопотреблением, но пока что это мечты.

Спасибо за ответ, ну круто тогда.

У меня шишка задымелась.

>>841769

Надо бы шапку подновить. Новый ОП молодец, но тему сисек не до конца раскрыл - книг можно досыпать, как минимум, и FAQ в последних вопросах подробнее сделать. И куда-то делись описания книг. КМК, это важно было - новички охренеют, если случайно первой из списка откроют ESL.

Какую же хуевую тут сделали капчу

реддит - кармапараша. Стоит кому-то написать что-то, что противоречит всеобщему "правильному" мнению - заминусуют.

как и весь "демократический" запад

Приведи пример адекватного поста, который заминусовали в /r/machinelearning или в /r/programming.

Гиперспектральные изображения. Сделай с ними что-нибудь. Можешь запилить сегментацию, классификацию. Там же потренерироваться в feature selection.

Только хз, где размеченные данные достать. У меня где-то были сами изображения.

распознай мнист

Привет, поцоны, кто курил Wavenet от DeepMind? У меня что-то подозрения, что это какой-то хайп. Я сам не смотрел толком, только на ютубе обзоры, на слух звучит не лучше обычного RNN, смотрел комментарии на реддите, там кидали ссылку на свертку новую какую-то, потом, руки дойдут, прочитаю.

Так еще Ын же постоянно во время курса жаловался на то, что у него пложно знакомых датасаентистов с зарплатами в шесть знаков, которые и малой части того, что он в своем курсе дает совсем не знают.

Звучит очень хорошо, но 90 минут на топовой карте для рендера 1 секунды, это слегка неюзабельно. Так что подожди полгодика, может оптимизацию какую придумают.

Съебал бы ты в обосцай со своими слесарями.

> DeepMind

> hype

> CNN

Лол.

Работает неплохо, вангую, что там будут ещё пытаться уменьшить количество настраиваемых параметров с помощью какой-нибудь архитектуры типа Inception.

Поясните за предмет.

Я так понимаю у вас тут три основных ветки: Большие данные, машинное обучение и нейронные сети.

Не пойму в чем их различия, что востребовано и что куда втыкается.

большие данные ет тип ентерпраиз, денюжка))

мошинное обучене ет для задратов

нейроночки ет тип когда import tensorflow as tf

Не до конца понятно, но все же.

Машинное обучение и нейронки - одни из методов анализа биг даты.

Нейронки в свою очередь можно вписать под машинное обучение.

нероночка - массив

гауссов процес - два масива

тренировка - обращение матрицы

нечётко-питушки соснули

> Уже придумали охуенно умных ботов, способных вести осмысленный диалог?

не

чатботы не приносят деньги

С этими товарищами не поймешь. Этот чел в каментах говорит, что в дипмайнде уже используют эту оптимизацию. При этом один чел якобы из дипмайнда скозал, что генерация секунды звука занимает полтора часа, а этот говорит, что две минуты. Крутят они что-то, секретность навели какую-то, наверное думают что это золотая жила. Хотя оно всего-то немного лучше старых рилтаймовых подходов.

человечество не может четко понять, что такое смысл

пытаются заменить его рандомом, выходит плохо

Так вот вопрос местным экспертам - раз пролог был создан для искусственного интеллекта, можно ли его средства применить в машинном обучении?

ты опоздал на 50 лет

Имхо, всякие императивные вещи на нём описывать очень неудобно. Но можно удобно делать запросы, да.

> удобные инструменты для описания кучки правил в какой-либо предметной области

Но их нужно забивать вручную.

Обучать подобные вещи (тащить структуру из данных) можно, используя графические модели:

http://research.microsoft.com/en-us/um/people/heckerman/tutorial.pdf

Вопрос как раз возник из того, что, насколько я понял, заставить систему получать знания извне геморройно настолько, что люди стали использовать для этого питон.

>tutorial.pdf

Ни черта не понял, что там говорится и как это относится к вопросу, объясни ньюфагу, пожалуйста.

Кароч, пролог хорошо умеет в семантические сети, семантические сети могут хорошо (неоч) представлять предметные знания. Эти сети в пролог должны вбивать людишки, а этого делать не охота. Поэтому начали придумывать сети, которые могли бы строиться по данным.

Сейчас вроде ещё модны гиперграфы, знаю, что их где-то в когнитивных архитектурах используют, но ссыль не дам.

Платина, но пох. (В архивах не нашел)

Что есть градиент для backprobagation на softmax слое?

Нет, не учили.

softmax слой это вектор-функция от многих переменных.

Марицу Якоби я найти смогу. Но я не понимаю, что передавать на предыдущий слой в backpropagation.

Чем тебе курсы откитаезы не угодили?

Пример на пикрилейтед. Стоит закрасить купальник и наш мозг думает, что баба голая.

То есть, если скормить АИ сотню тыщ голых баб, сможет ли он дорисовать сиськи в данном случае?

попробуй

И хуйцы тоже дорисует.

Гугли image inpainting.

https://people.eecs.berkeley.edu/~pathak/context_encoder/resources/result_fig.jpg

ML здорового человека в это могло еще в начале 80-х. Это потом поналезло бабуинов с быдлонейроночками, которые на гугловских кластерах еле дышат.

>>845489

>>845536

Ага, нейроночка ищет в гугле оригинальную картинку вместо покоцаной.

Hipster kitten-клоун в ML, спешите видеть.

Learning Deep Generative Models - Ruslan Salakhutdinov

DRAW: A Recurrent Neural Network For Image Generation

Generative Adversarial Nets

и тд

Тысячи статей, и на гитхабе 100% есть имплементации, только обучуающие данные нужны "баба в купальнике -> голая баба", это сложно достать. Легче будет закрашивать уже голым бабам сиськи. Но все равно это нудная и рутинная работа.

У меня научный интерес к данному вопросу. Если говорить о практическом применении, можно было бы сделать виртуальные примерочные, не выходя из дома подбирать себе одежду, опять же аватары для виртуальных миров. Или распознавание картинок - это предел?

Ну я думал это из области ai, чем как раз машинное обучение занимается, научить программу строить трехмерные модели на основе видео/фото файлов

натрави другую сеть на локализацию сисек

Больше похоже на классический computer vision. Другой вопрос, что без системы типа кинекта (с освещением сеткой) нормальную точность не получишь.

http://old.ektf.hu/tanszek/matematika/hofi/head_model_NN.pdf

хотел другую статью найти, там строили 3д модели зданий и тд, в глубину можно было ходить, но 10 секунд в гугле только это выдали

Спасибо, схоронил, я вообще по фану спросил, но сама тема интересна

> Жду БУТКЕМПЫ за 20 ТЫСЯЧ ДАЛЛАРОВ уровня СТАНЬ ДАТА САЕНТИСТОМ или ИКСПЕРТОМ ПО МАШИН ЛЕРНИНГУ за 12 недель!

Уже есть такое. Видел на днях даже.

http://newprolab.com/bigdata/?utm_source=habr&utm_medium=habr&utm_campaign=new

Интересно, за сколько времени окупается этот курс?

От курса Ына отличается лишь наличием хадупов, азуры и прочей энтерпрайзной мишуры без бара, важной, но 180к это не стоит

>Уже придумали охуенно умных ботов, способных вести осмысленный диалог?

https://www.youtube.com/watch?v=pIORV4DMbHQ

пиздец как дорого

почему с этими пидорасами никто не конкурирует

где амуде?

> Delivery £11.99

лолблядь

Кароч, пацаны, я в универе немного мутил регресси в ехеле + смотрел пару курсов по анализу данных, но из-за этого хайпа не могу понять что и как изучать, в каком порядке.

Энивей, тут такое дело.

Наткнулся на вакансию младшего аналитика, прислали несколько тестовых заданий.

1. 1 сентября 2015 года на двух телеканалах разместили два ролика с различными номерами заказа такси. В течение недели оба ролика прокрутили по 40 000 раз. В течении этой недели на первый номер поступило 10 000 звонков и было совершено 7 670 поездок, а на второй — 12 000 звонков и 8100 поездок. Маркетолог просит у вас совета: какой канал оставить, а какой отключить? Что вы ему ответите? Обоснуйте свой ответ.

2. При доставке товара, заказчик может оценить качество работы курьера, либо положительно (поставив «лайк»), либо отрицательно (поставив «дислайк»). Предложите систему (формулу или набор правил) расчета рейтинга курьеров на основе истории их оценок, которая позволила бы определять и отсеивать курьеров, которые работают хуже остальных (код или какие-то другие материалы, созданные в ходе решения приветствуются).

Выглядит одновременно и легко и, мне кажется, не все тут так просто.

Эни айдиас в какую сторону копать?

Чувак в 17 лет имплементит топовую статью с переднего края машинлернинга. Если это не круто, то что тогда круто? Вспомни что ты делал в 17 и ужаснись.

Круто делать что-то новое, а не import tf.

Ну... Я бы, пожалуй, сделал его членом своего стартапа. Если ты понимаешь, о чем я.

Анончики, есть ли исчерпывающие туторы по information theoretic learning? Чтобы с ответами на вопросы, чем критерий коррэнтропии пизже критерия относительной энтропии и прочее. Гугл даёт только что-то отдельными статьями. Я заебался.

поделитесь опытом/историей плиз

А в чём проблема изучить её самостоятельно?

Благо литературы, курсов, ресурсов всяких более чем достаточно.

Здесь проблема втом, чтобы вообще найти кого-нибудь, работающего в сфере ML. А ты тут ещё без вышки просишь, лол.

>>853007

> А в чём проблема изучить её самостоятельно?

Количество времени, которое нужно потратить, высокий порог вхождения, постоянное ощущение того, что ты что-то не понимаешь. Не каждому дано это.

А вуз то чем тебе поможет? Единственное чем вуз отличается от самообразования, это то, он более менее заставляет учиться

Ничем.

Однако, практика показывает, что порой распиздяй, дотянувший до четвёртого курса, может вытащить из глубин разума хоть какие-то минимальные знания анализа.

Проглядел:

https://download.cdn.yandex.net/shad/exam-2014.pdf

Знаю как решается одна задача, видел ее в учебнике по терверу.

Монеты наверное тоже просто, все остальное сходу не знаю как решать. 5 часов мне явно не хватит.

>>853050

Умение решать подобные задачи - без пизды охуительный и полезный навык, без сарказма. Но освоить мл на слесарском уровне можно, и не попадая под монструозные требования шада.

Просто берёшь курсы китаёзы, бишоп и мёрфи и без задней мысли проходишь весь материал с прорешиванием всех задач. Времени уйдёт уйма, но другого пути я не знаю.

Только такой путь и есть. ШАД - ебота та еще. Типичная подмена понятий "раз мы соберем умнейших людей ебическими экзаменами не по теме, ЭТО ЗНАЧИТ, что мы учим хорошо". А не потому что люди умные и их похуй, как учить.

отклеилась

Пойду у соседа вьетнамца спрошу, а нет, не спрошу, мне похуй.

Он китаец из гонконга.

чел с высшим техническим, инженер. прошел курсы от Ng,на кэгле есть опыт, несколько книжек прочитал.

Пока что вакансии видел только для лютых задротов-надмозгов, к коим не отношусь

я работал неделю на апверке за 15 баксов в часов, потом уехал на юга и забил. Мне очень стыдно, и, боюсь, другой шанс устроиться в мл с моим гуманитарным образованием у меня очень нескоро появится.

и очень странно было работать, так как если клепать сайтики, то там все отлично, а тут большая часть времени уходит на тренировку моделей, чтение нужных статей и тд, а импорт тензорфлоу эз тф - это 2 минуты.

> Быть великовозрастным вкатывальщиком, полным нубом в кодинге

> Не знать матана, не мочь даже вывести формулу для квадратных уравнений

> Никогда не осилить и 20% обсуждаемых в треде вещей, куда уж там прочесть Бишопа/Мёрфи

> Никогда не побывать в писечке няшной мл-щицы Леночки и не уехать к ней в Канаду няшиться под пледиком

Зачем жить, байесаны?

ну, профиль на upwork.com (тогда одеск еще) у меня давно висит, хотя опыта вообще нет. Один раз получил заказ года три назад на парсинг, когда осваивал только питон и программирование, но я не смог разобраться с автоматическими сменами прокси и прочим, денег за проект не получил. Летом обновил профиль, добавил туда инфу про машинное обучение. Поговорил с дядькой по скайпу на английском. Что делал - в этом весь вопрос. Меня просили помочь придумать, как их проект можно улучшить с помощью нейроночек, но фирма, видимо, не очень большая, и данных мало (мне дали всего 300 картинок с описаниями, обучаться было проблематично), так по картинкам выдавал текст из скольки-то там категорий, категории пересекались. Я порыпался с недельки две-три, что-то обучил сильно переобученное и с низкими результатами, на том и все закончилось.

Зависит от твоего бэкграунда.

Нубам с курсы китаёзы.

Людям с оброзованием можно сразу брать пару из Бишопа и Мёрфи.

Andrew Ng, mlclass на coursera

Вы видите копию треда, сохраненную 4 ноября 2016 года.

Можете попробовать обновить страницу, чтобы увидеть актуальную версию.

Скачать тред: только с превью, с превью и прикрепленными файлами.

Второй вариант может долго скачиваться. Файлы будут только в живых или недавно утонувших тредах. Подробнее

Если вам полезен архив М.Двача, пожертвуйте на оплату сервера.